L’intelligence artificielle vient avec son lot de promesses (cf. les promesses de l’intelligence artificielles). Nous n’imaginons pas encore tout le potentiel de cette technologie, car il y a une rupture qualitative avec l’informatique comme nous la connaissons jusqu’à présent. Depuis la récente sortie de GTP-3 en 2020 (cf. GPT-3 Demo), nous avons un petit aperçu de ce dont le monde de demain sera fait. Je suis particulièrement bluffé par la génération automatique de code debuild.co ou encore AI Dungeon, un jeu de rôle interactif aux possibilités infinies. Cependant, tout ceci a un coût au niveau des individus et de la société, mais lequel?

L’émergence d’un problème d’ordre nouveau

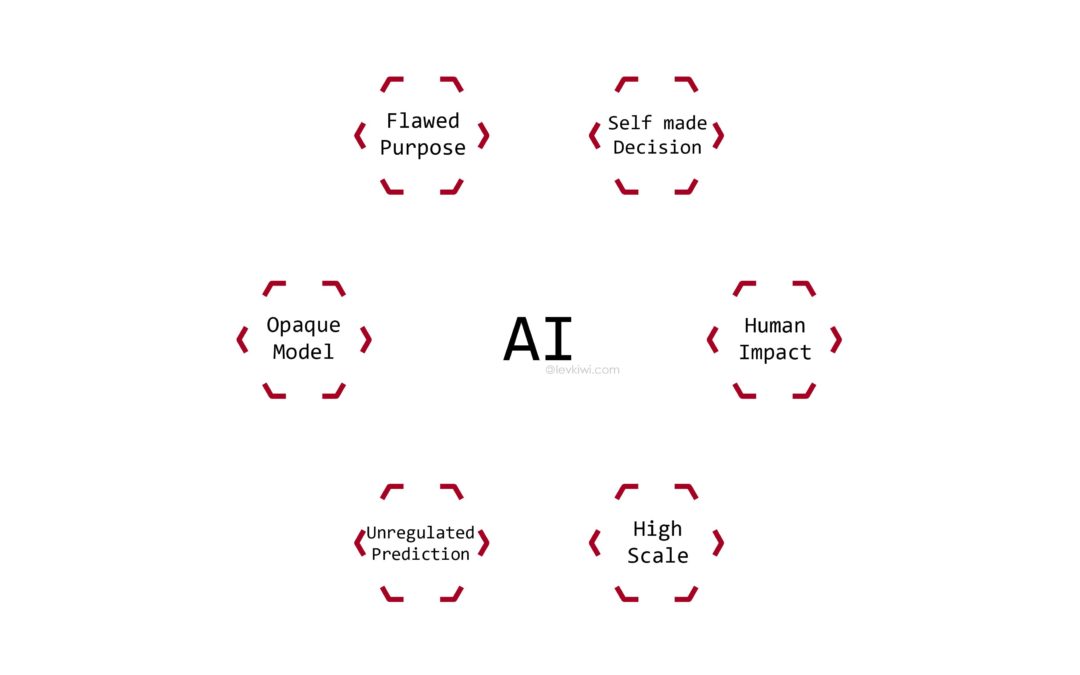

Comme toute propriété émergente (cf. Emergence et Intelligence (Artificielle)) l’intelligence artificielle offre des solutions d’un ordre qualitativement nouveau. Ses prouesses sont tellement surprenantes qu’elles occultent parfois les aspects négatifs de cette technologie. Ces problèmes ne sont malheureusement pas attribuables à une seule et unique cause, mais à un ensemble de causes liées entre elles. C’est un problème émergent d’un ordre qualitativement nouveau. Cet article ne va pas traiter de façon exhaustive le problème mais a l’intention de commencer une conversation.

Algorithmes opaques… la porte ouverte aux discriminations

De manière générale, un code très complexe souffre d’opacité. Les développeurs ont beau l’organiser de la meilleure manière possible, il va inéluctablement s’obscurcir. Pour illustrer ceci, il suffit de prendre l’anecdote de Windows 9 de Microsoft. En effet, vous n’en n’avez probablement jamais entendu parler. Microsoft a décidé de passer directement de la version 8.1 à 10. Selon les dires d’un développeur qui a préféré rester anonyme, Microsoft craignait que le code du nouvel OS contiennent encore des reliques du passé faisant allusion à Windows 95 ou 98. Ceci aurait été un enfer pour les programmeurs à débugger.

Par ailleurs, l’utilisation d’algorithmes de machine learning augmente de façon inhérente l’opacité des algorithmes. Même les modèles les plus simples nécessitent des bases statistiques et mathématiques afin de les interpréter. Rappelons que ces algorithmes apprennent des patterns à partir de données qui sont passées en entrée afin de calculer un output, une prédiction (cf. Apprentissage et Machine Learning). Ainsi le développeur confie le soin à la machine de décider l’importance de chaque paramètre. Les algorithmes de machine learning et de data mining de bases restent relativement compréhensibles, pour autant que le data scientist connaisse leurs fonctionnements ainsi que leurs assomptions. Ainsi, on peut aisément expliquer les facteurs qui influencent la prédiction. Cependant, les nouveaux modèles utilisant par exemple des réseaux de neurones le sont beaucoup moins (cf. Deep Learning… Deux minutes top chrono!). Il est très difficile d’expliquer pour un humain les décisions de la machine.

Le risque majeur de ces algorithmes est dans les biais que peuvent contenir les modèles. Ces biais vont se traduire par des variations significatives dans les prédictions en (dé)faveur de certains groupes de la population. En fonction du contexte d’application, l’IA risque de créer ou perpétuer des discriminations sociales, raciales, de genres, etc. C’est malheureusement déjà le cas avec les résultats de recherche de Google.

… setting the gender to female resulted in getting fewer instances of an ad related to high paying jobs than setting it to male.

Datta et al. (2015)

Automated Experiments on Ad Privacy Settings : A Tale of Opacity, Choice, and Discrimination

Des chercheurs ont conduit des analyses sur le moteur de publicité de Google (Google Ads) dans le contexte de la recherche d’emploi. Ils ont observé que les femmes étaient discriminées par le moteur en ayant moins de publicités pour des métiers bien payés. Ce genre de biais se retrouve aussi dans d’autres moteurs de recherches spécifiques au recrutement s’appuyant sur des algorithmes de machine learning (cf. Le Chen et al. (2018) Investigating the Impact of Gender on Rank in Resume Search Engines).

Prédictions non-régulées… l’absence de consentement est un viol

Un autre problème apparait dans l’utilisation des prédictions faites par les algorithmes de machine learning. Actuellement, il n’est pas très commun que l’utilisateur final puisse avoir le dernier mot sur l’IA. Dans le cas d’usage illustré ci-dessus, si vous êtes une femme, il est actuellement impossible de donner un feedback à Google pour que le moteur corrige ses prédictions. Les résultats sont affichés avec leurs biais inerrant et vous ne pouvez pas vous y opposer. Qu’en sera-t-il lorsque la majorité des logiciels feront des prédictions à votre propos sans votre consentement? Par exemple: faut-il vous accorder un prêt hypothécaire? A combien s’élève votre leasing? Faut-il montrer votre CV au recruteur pour le job? etc… La promesse de l’intelligence artificielle est dans l’automation et l’efficacité. Malheureusement dans ce processus, certains développeurs ont oublié ce que veut dire le consentement et l’application a perdu son humanité. En l’état, il est difficile de désactiver toutes ces prédictions et de demander qu’une personne réelle traite votre dossier.

De plus, certaines implémentations de ces algorithmes sont par nature automatiques. Prenons par exemple les suggestions de vidéos sur Youtube et la fonction autoplay. Lorsque vous terminez de visionner une vidéo, la suivante s’enclenche automatiquement. A priori, cela semble plutôt intéressant comme design. Le problème est que ce petit bout de code est conçu pour vous prendre plus d’attention et faire en sorte que vous restiez sur la plateforme le plus longtemps possible. Comme l’explique Tristan Harris lors du Hearing on « Americans at risk: Manipulation and deception in the digital age » du 8 janvier 2020, la plateforme aura tendance à vous montrer des contenus de plus en plus choquant, révoltant et/ou extrême. Par exemple, si une jeune adolescente regarde une vidéo sur la perte de poids, Youtube propose en autoplay une vidéo sur l’anorexie. Dans le cas d’une vidéo d’actualité sur les attentats du 11 septembre 2001, l’autoplay propose des vidéos suggérant des théories du complot. Tandis que des vidéos sur l’alunissage de Neil Armstrong sont suivies par des vidéos de théories suggérant que la terre est plate. Depuis 2018, j’espère que ces prédictions ont été corrigées, mais qu’en est-il de toutes celles qui ne le sont toujours pas? Ci-dessous l’intervention de Tristan Harris. Allez directement à 1:24:30 si ceci ne se fait pas automatiquement.

Mise à l’échelle… l’algorithme devient une arme de destruction massive

Finalement, ces algorithmes ne sont pas si offensifs au niveau individuel. Cependant, aussi insignifiant qu’est l’autoplay pour une personne, cela n’est plus le cas lorsqu’on considère que des milliards d’individus se rendent sur la plateforme et sont influencer tous les jours. Suivant la loi des grands nombres, en moyenne la masse des individus va être influencée significativement. Ceci peut se traduire par la suite sur les élections présidentielles, la santé mentale et la prévalence de troubles psychologiques, ou même potentiellement causer des guerres civiles. A cette échelle, les choix applicatifs pris par quelques développeurs dans la Silicon Valley ont un impact international.

Vers la nécessité d’une régulation des algorithmes

With technology, you don’t have to overwhelm people’s strengths. You just have to overwhelm their weaknesses. This is overpowering human nature. And this is checkmate on humanity.

Tristan Harris

Est-ce le début de la fin de l’humanité ou la fin du début innocent et ignorant de l’intelligence artificielle? Le problème émergeant que nous pose l’intelligence artificielle est réel. Comme le met en avant Cathy O’Neil (2016) Weapons of Math Destruction, ces outils partagent quelques caractéristiques principales : ils sont opaques, non-régulés et difficiles à contester. De plus, ils ont des champs d’applications à de très grandes échelles, ce qui amplifie les biais inhérents et touche des populations de plus en plus larges. On arrive à un stade où des lois doivent être écrites afin de réguler ces intelligences artificielles. Ces régulations devront prendre en compte la nature émergente du problème. On ne peut réduire ce problème à la protection des données (comme l’a fait la GDPR), ni à aucun des facteurs spécifiques mentionnés ci-dessus. La solution doit être de nature émergente et systémique elle aussi.